Deepfakes: Αυξανόμενος Κίνδυνος για Δημόσια Πρόσωπα Παγκοσμίως

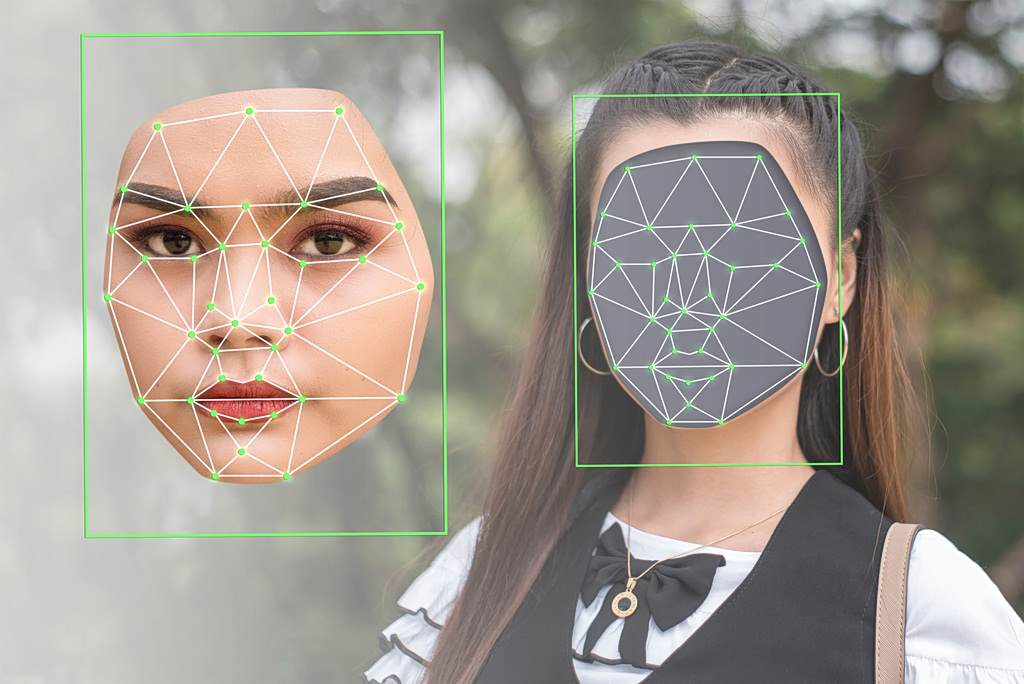

Η χρήση ψευδών ψηφιακών απεικονίσεων, γνωστών ως deepfakes, με τη χρήση τεχνητής νοημοσύνης (AI) σε χώρες όπως η Νότια Κορέα, η Ινδία και η Αυστραλία, αναδεικνύει τον διαρκώς αυξανόμενο κίνδυνο που εγκυμονεί το περιεχόμενο deepfake για τα δημόσια πρόσωπα και τις δημοκρατικές διαδικασίες παγκοσμίως. Τα αναφερόμενα περιστατικά ποικίλλουν από τη μη εξουσιοδοτημένη χρήση της εικόνας διασημοτήτων έως την κατασκευή πολιτικών βίντεο με στόχο την παραπλάνηση των ψηφοφόρων.

Στη Νότια Κορέα, η εταιρεία Ace Factory, που εκπροσωπεί τη γνωστή ηθοποιό Yeom Hye-ran, επιβεβαίωσε στις 31 Μαρτίου ότι μία ταινία που δημιουργήθηκε με τεχνητή νοημοσύνη, με τίτλο “Geomchimwon”, χρησιμοποίησε την εικόνα της ηθοποιού χωρίς την απαιτούμενη συγκατάθεση. Σύμφωνα με δήλωση της εταιρείας, δεν υπήρξε προηγούμενη επικοινωνία ή άδεια για την παραγωγή του εν λόγω βίντεο. Μετά από τις αντιδράσεις, το βίντεο αποσύρθηκε από την πλατφόρμα YouTube.

Στην Ινδία, ο βουλευτής του Κόμματος του Κογκρέσου, Shashi Tharoor, κατήγγειλε ένα deepfake βίντεο το οποίο τον παρουσίαζε ψευδώς να εκφράζει επαίνους προς την ομάδα κρίκετ του Πακιστάν, αναφορικά με τη στάση της στο μποϊκοτάζ του Παγκοσμίου Κυπέλλου ICC Men’s T20 2026. Ο κ. Tharoor χαρακτήρισε τις δηλώσεις που του αποδίδονταν ως “ανόητες” και προειδοποίησε μέσω των μέσων κοινωνικής δικτύωσης να μην πιστεύεται περιεχόμενο που δεν έχει αναρτηθεί από τον ίδιο, επισημαίνοντας ασυμφωνίες στην κίνηση των χειλιών και αλλοιωμένο ήχο. Η εφημερίδα Times of India ανέφερε ότι το αρχικό υλικό ήταν ομιλία του κ. Tharoor σχετικά με τον διαχωρισμό πολιτικής και αθλητισμού.

Στην Αυστραλία, ψεύτικα βίντεο που απεικόνιζαν την πρωθυπουργό της Βικτώριας, Jacinta Allan, κυκλοφόρησαν στα μέσα κοινωνικής δικτύωσης, εγείροντας ανησυχίες για την ενδεχόμενη επίδραση της τεχνητής νοημοσύνης στις επερχόμενες εκλογές του Νοεμβρίου. Ειδικοί έχουν προειδοποιήσει για τη δυσκολία αντιμετώπισης τέτοιου περιεχομένου, καθώς οι ψηφοφόροι δυσκολεύονται να “ξεχάσουν” όσα έχουν δει, ακόμη κι αν αυτά αποδειχθούν ψευδή, όπως ανέφερε η εφημερίδα Herald Sun. Το Sky News μετέδωσε ότι τα βίντεο προσομοίαζαν αυθεντικές συνεντεύξεις Τύπου, γεγονός που καθιστούσε τον εντοπισμό της παραποίησης ιδιαίτερα δύσκολο για το κοινό.

Τα παραπάνω περιστατικά υπογραμμίζουν την ταχεία εξέλιξη της τεχνολογίας των deepfakes, η οποία υπερβαίνει τις δυνατότητες των ρυθμιστικών αρχών και των πλατφορμών κοινωνικής δικτύωσης. Τα δημόσια πρόσωπα παγκοσμίως βρίσκονται αντιμέτωπα με την πρόκληση της αντιμετώπισης της παραπληροφόρησης, συχνά χωρίς επαρκή υποστήριξη.